Interface編集部

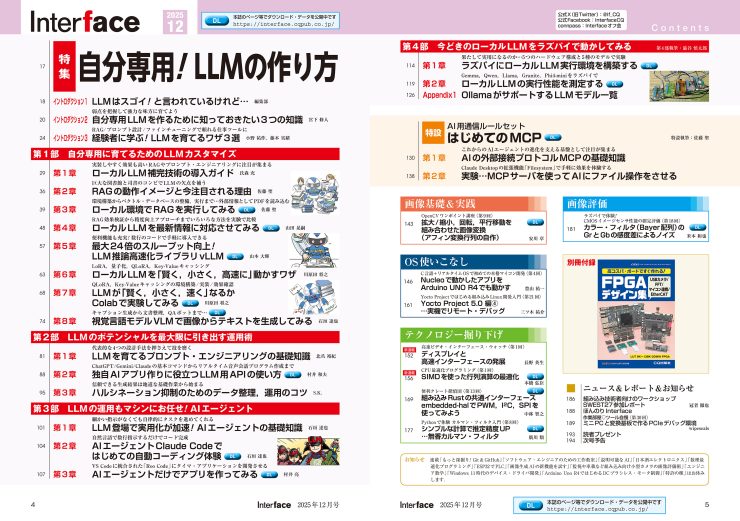

12月号特集『自分専用!LLMの作り方』の見どころ紹介&サポート情報

特集の魅力をササっと紹介!

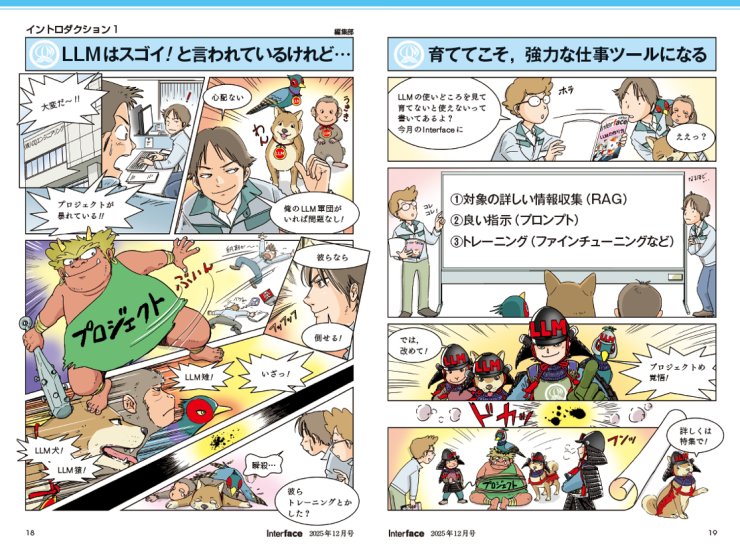

-LLMは自分専用に育ててこそ強力な仕事ツールになる-

ChatGPT,Geminiなど現在のLLMは,まるで人間と対話しているかのような自然な受け答えをします.オープンソースのソフトウェアとして公開されるものも増えてきて,使いやすい環境が整ってきました.しかし,いざ仕事などで本格的に使ってみようとすると,

・イメージしていたような結果が生成されない

・事実と異なる回答をする

・人間がやったほうが早い

ということも少なくないようです.これは,LLMの構造的な欠点が原因です.今では,このような欠点を解決するLLMのカスタマイズ技術が多く登場しています.特集では,それらの技術の中でも特に注目を集めるRAG,プロンプト,ファインチューニングを中心に,Pythonコードと具体例で解説します.

——————–

主な内容

——————–

●イントロダクション

・自分専用LLMを作るために知っておきたい3つの知識

・LLMを育てるワザ3選

●第1部 自分専用に育てるためのLLMカスタマイズ

本格的に使うために必要な,LLMを賢く,速く,でも軽量にする技術を,Pythonで実装して解説します.

・ローカルLLMでのRAG/精度向上(RAG,QLoRA)/軽量化(QLoRA)/高速化(vLLM)/画像対応(VLM)

●第2部 LLMのポテンシャルを最大限に引き出す運用術

・LLMへのうまい指示の出し方(プロンプト設計)

・LLM用APIの使い方

・ハルシネーションを抑制するデータ整理,運用のコツ

●第3部 LLMの運用もマシンにお任せ!AIエージェント

・AIエージェントって何?

・データを読み込んでグラフを描画させるコードを生成

・AIエージェントだけでアプリ作り

●第4部 今どきのローカルLLMをラズパイで動かしてみる

主要なLLMモデルである,Genmma,Qwen,Llama,Granite,Phi4-miniについて,ラズパイでどこまで動くか実験します.

●特設 AI用通信ルールセット はじめてのMCP

MCP(Model Context Protocol)とは,AIアプリケーションと外部のデータソースやツールをシームレスに接続するための標準化されたプロトコルです.AIエージェントを支える基盤として期待されている技術です.

今回はMCPの概要を示すとともに,MCPサーバを使ってAIにファイル操作をさせる実験を行います.

———————

目次紹介

———————

目次詳細と記事サンプルはコチラ

——————–

記事サポートページ

——————–

・第1部第1章「ローカルLLM補完技術ガイド」はコチラ

・第1部第8章「視覚言語モデルVLMで画像から説明テキスト生成」はコチラ(準備中)

————————–

ダウンロードデータ取得

————————–

記事中で紹介したプログラムやプロンプトなどはコチラ

————————

関連イベント情報

————————

・2025年11月21日…EdgeTech+ 2025のCQ出版社ブースにてセミナ・イベントを実施します.

11/21金曜は,AI/LLMに関連したミニ・セミナを企画中です.本特集の筆者も出演予定です!

詳細はコチラ